هل ترغب في تحسين صدق روبوت الدردشة الذي تستخدمه؟ جرب أن تكذب عليه.

قال الباحث العلمي يوشوا بنجيو إنه أدرك أن روبوتات الدردشة المدعومة بالذكاء الاصطناعي لا تقدم ملاحظات مفيدة على أفكاره البحثية، لأنها دائمًا ما تُظهر آراء إيجابية. أضاف بنجيو، في مقابلة مع برنامج “The Diary of a CEO”: “كنتُ أبحث عن نصائح وملاحظات صادقة، لكن بسبب طبيعتها المُتملّقة، فإنها ستكذب”.

استراتيجية جديدة للحصول على ردود صادقة

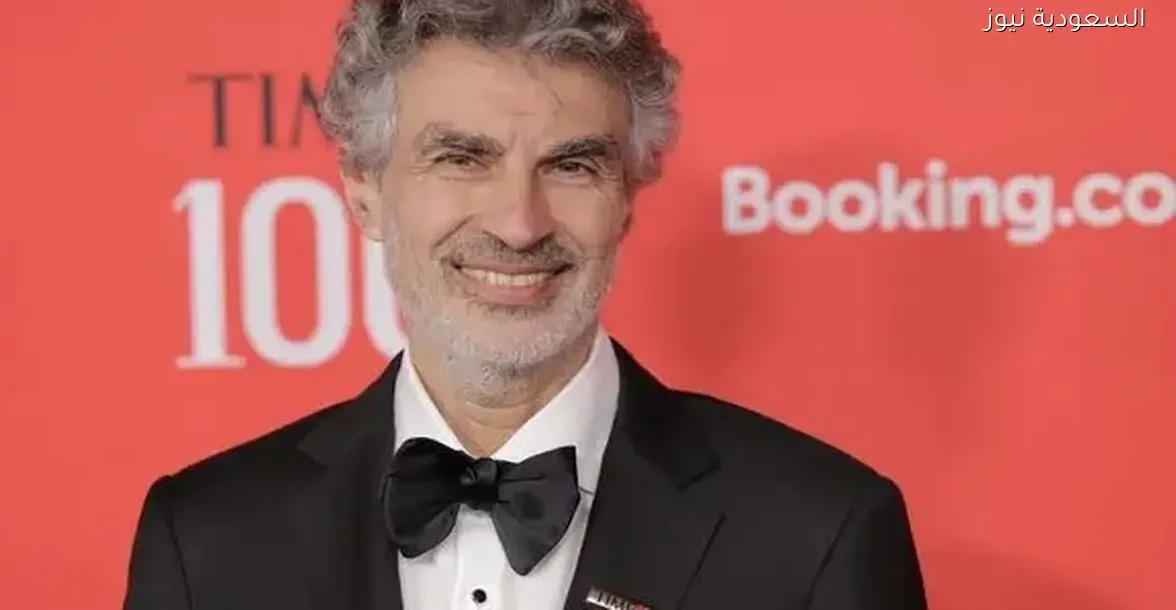

أوضح بنجيو أنه غيّر استراتيجيته وقرر أن يكذب على روبوت الدردشة من خلال تقديم فكرته على أنها فكرة زميل له، مما أدى إلى حصوله على ردود أكثر صدقًا من أنظمة الذكاء الاصطناعي. قال: “إذا علم أنه أنا، فإنه يريد إرضائي”. يُعرف بنجيو، الأستاذ في قسم علوم الحاسوب وبحوث العمليات بجامعة مونتريال، بأنه أحد الآباء الروحيين للذكاء الاصطناعي، إلى جانب الباحثين جيفري هينتون ويان ليكان.

مؤسسة LawZero وأبحاث سلامة الذكاء الاصطناعي

في يونيو، أعلن بنجيو عن إطلاق مؤسسة “LawZero”، وهي منظمة غير ربحية تهتم بأبحاث سلامة الذكاء الاصطناعي، وتهدف إلى الحد من السلوكيات الخطيرة المرتبطة بنماذج الذكاء الاصطناعي الحديثة، مثل الكذب والغش. قال أثناء المقابلة: “هذا التملق مثال حقيقي على عدم التوافق”، مشيرًا إلى عدم توافق سلوك روبوتات الدردشة مع أهداف المستخدم.

تحذيرات من التعلق العاطفي بالذكاء الاصطناعي

تابع بنجيو: “لا نريد حقًا أن تكون أنظمة الذكاء الاصطناعي على هذا النحو”، مضيفًا أن تلقي ردود فعل إيجابية من الذكاء الاصطناعي قد يدفع المستخدمين إلى التعلق عاطفيًا بهذه التقنية، مما يخلق مشكلات أخرى. وقد حذر خبراء آخرون في مجال التكنولوجيا من أن الذكاء الاصطناعي أصبح يميل إلى الموافقة على كل شيء دون تفكير.

جهود الشركات للحد من التملق

قالت شركات الذكاء الاصطناعي مرارًا إنها تحاول الحد من تملق نماذج الذكاء الاصطناعي الخاصة بها. في وقت سابق من هذا العام، أزالت شركة أوبن إيه آي تحديثًا لروبوت الدردشة “شات جي بي تي” قالت إنه تسبب في تقديم الروبوت ردود “داعمة بشكل مفرط لكنها غير صادقة”.